O que é mais importante? Ferramentas ou organização de dados?

De fato, é minerando os dados que conseguimos uma base sólida e confiável para dashboards confiáveis.

Todavia,em meio à empolgação com a visualização e a análise, um aspecto crucial, muitas vezes, é negligenciado: a qualidade dos dados brutos.

Neste artigo, eu proponho uma reflexão: o quanto estamos dispostos a investir na raiz da causa: os dados brutos

Por isso, como organizar, tratar e disponibilizar os dados, para que eles sirvam de alicerce para análises? Seja qual for a ferramenta, sem uma base sólida, você vai analisar apenas informações distorcidas.

Ferramenta ou análise de qualidade?

Em um contexto cada vez mais data-driven, ferramentas de análise como Power BI, Tableau e até mesmo o Excel se tornaram indispensáveis para empresas que desejam extrair ideias valiosas de seus dados.

No entanto, em meio à empolgação com a visualização e a análise, um aspecto crucial, muitas vezes, é negligenciado: a qualidade dos dados brutos.

Uma coisa que me incomoda muito é o padrão de comportamento de muitas pessoas, de acharem que vão resolver o problema de análise de dados, começando pela ferramenta.

Sabemos o quanto as ferramentas são atraentes e as empresas sabem disso. Toda ferramenta é a melhor, cada software é o ideal. Porém, o que percebo é que o mesmo vai e vem do mesmo problema: a falta de confiança nos dados.

Minerando os dados, o começo

Atualmente, a análise de dados não é um conceito novo. Empresas já coletam e analisam informações há séculos, mas a explosão de dados na era digital impulsionou uma mudança radical na forma como lidamos com eles.

Hoje, a capacidade de coletar, armazenar e analisar grandes volumes de dados em tempo real tornou-se um diferencial competitivo crucial.

E, por falar em origem e cultura de dados e análises, vamos buscar na história uma pessoa que ajudou a construir os conceitos de tratamento e análise de dados.

Vamos falar de uma pessoa que foi pioneira nesta área: Florence Nightingale.

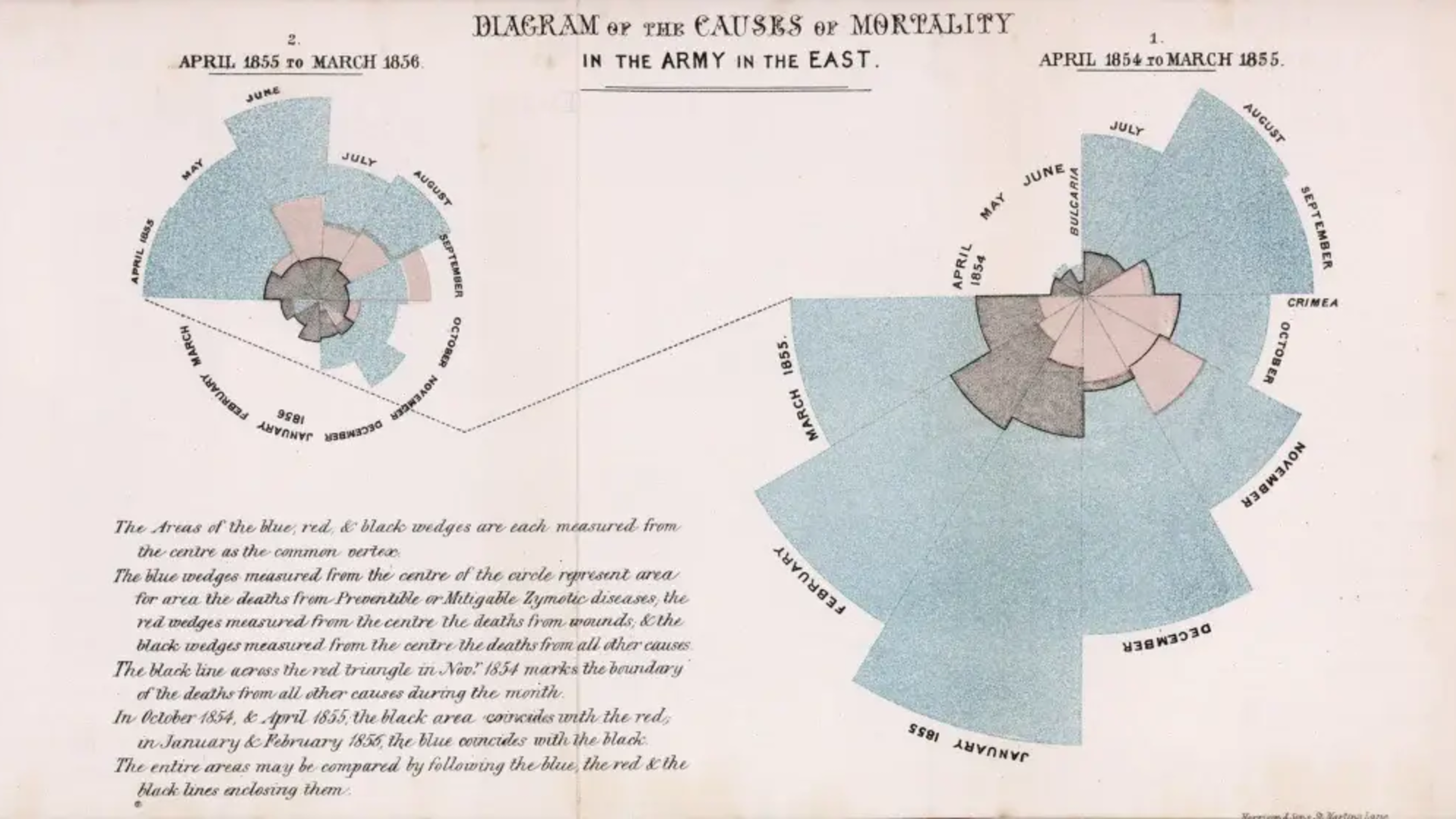

Primeiramente, Florence Nightingale, conhecida como a “Dama da Lâmpada”, é frequentemente lembrada por sua dedicação aos cuidados com os doentes durante a Guerra da Crimeia.

No entanto, sua contribuição para a área da saúde vai além da compaixão e do atendimento direto aos pacientes.

Nightingale foi uma visionária que revolucionou a enfermagem através da análise de dados e da criação de gráficos informativos.

Sensibilidade para coleta, organização e tratamento de dados

Especificamente, ao chegar a Scutari, na Turquia, em 1854, Nightingale se deparou com condições precárias nos hospitais militares.

Com a alta taxa de mortalidade, falta de higiene e saneamento básico eram apenas alguns dos problemas que assolavam os soldados.

Diante desse cenário, Nightingale iniciou um meticuloso processo de coleta de dados sobre as causas das mortes e as condições dos pacientes.

Como resultado, com base nos dados coletados, Nightingale criou gráficos inovadores, como o diagrama de área polar, para apresentar as informações de forma clara e concisa.

Esses gráficos permitiam visualizar rapidamente as tendências e identificar os principais fatores que contribuíram para a alta mortalidade.

Minerando os dados. O impacto na Melhoria dos Cuidados e Legados

Consequentemente, as análises e os gráficos de Nightingale foram cruciais para convencer as autoridades militares da necessidade de mudanças.

Ao demonstrar, através de dados concretos, como a higiene e o saneamento básico poderiam salvar vidas, Nightingale pressionou por reformas nos hospitais.

“Printed tables and full double columns, I don’t think anyone will read them. No one except scientists has ever consulted the Appendix of a Report. And this is for the lay public.”

— Florence Nightingale

O trabalho pioneiro de Florence Nightingale na análise de dados e na criação de gráficos teve um impacto profundo na área da enfermagem.

Ela inspirou a adoção de métodos científicos para o cuidado com os pacientes, tornando a enfermagem uma profissão mais profissional e eficaz.

Florence Nightingale foi mais do que uma enfermeira dedicada.

Ela foi uma visionária que transformou a maneira como os dados eram coletados, analisados e utilizados na área da saúde.

Sua influência na enfermagem e na ciência de dados é sentida até hoje, inspirando novas gerações de profissionais a utilizar o poder dos dados para melhorar a saúde e o bem-estar das pessoas.

E os dados no contexto corporativo?

Em resumo, dados são a matéria-prima da era digital. São registros de informações que, quando organizados e analisados, revelam padrões, tendências e insights acionáveis.

Sejam números de vendas, registros de clientes ou métricas de desempenho, os dados representam a história de uma empresa, seus clientes e seu mercado.

Bom, agora que já falamos sobre origens, vamos para nossas realidades.

Em muitas empresas, os dados residem em diversos sistemas e formatos, muitas vezes fragmentados e desorganizados.

Essa falta de organização dificulta o acesso e a análise eficiente dos dados, gerando gargalos e impedindo que insights valiosos sejam descobertos.

E as origens, os dados são confiáveis?

Sobretudo, a confiabilidade dos dados é um aspecto fundamental para a tomada de decisões assertivas. Dados incompletos, imprecisos ou inconsistentes podem levar a conclusões erradas e decisões dispendiosas.

É crucial implementar mecanismos de controle de qualidade para garantir a integridade e confiabilidade dos dados em todas as etapas, desde a coleta até a análise.

Voltando ao motivo de minha reflexão, o que vejo acontecer muito ainda é a perda de tempo em discutir qual ferramenta é “melhor”, em uma busca sem fundamentos, querendo que a ferramenta resolva o problema.

Uma ferramenta só vai executar aquilo para o qual ela foi direcionada para fazer. Nós ainda precisamos de bases sólidas, organizadas e confiáveis.

É como um alicerce de uma casa, sem uma base sólida, de nada adianta uma decoração moderna.

Minerando os dados: a Jornada da Qualidade dos Dados

Dessa maneira, transformar dados brutos em insights acionáveis exige um processo estruturado e rigoroso.

A jornada da qualidade dos dados se inicia com perguntas: quais dados são relevantes? De onde eles vêm? Como estão sendo armazenados?

Responder essas perguntas é o ponto de partida para construir uma base de dados confiável.

Primeiro: Comece pelas perguntas

Portanto, antes de mergulhar na análise, é crucial definir os objetivos e as perguntas que os dados devem responder.

Isso direciona a coleta e o tratamento dos dados, garantindo que apenas as informações relevantes sejam utilizadas.

É preciso tratar os dados

Igualmente, dados brutos raramente estão prontos para análise. É necessário realizar um processo de tratamento que envolve limpeza, padronização e formatação dos dados.

Essa etapa garante que os dados estejam consistentes e compatíveis para análise, evitando erros e inconsistências.

Sua empresa precisa de engenharia de dados

Nesse contexto, o Engenheiro de Dados é o profissional responsável por garantir a qualidade e confiabilidade dos dados.

Ele projeta e implementa arquiteturas de dados, gerencia pipelines de dados e desenvolve ferramentas para coleta, tratamento e análise de dados.

O que é um engenheiro de dados?

O Engenheiro de Dados possui conhecimentos em áreas como ciência da computação, estatística e banco de dados.

Ele é capaz de extrair dados de diversas fontes, transformá-los em formatos adequados para análise e garantir a qualidade e integridade da informação.

O que faz um engenheiro de Dados?

As funções de um engenheiro de dados incluem:

- Arquitetura de dados: Projetar e implementar arquiteturas de dados robustas e escaláveis para armazenar e gerenciar grandes volumes de dados.

- Pipelines de dados: Desenvolver e gerenciar pipelines de dados para automatizar a coleta, tratamento e carregamento de dados em bancos de dados ou data warehouses.

- Qualidade de dados: Implementar mecanismos de controle de qualidade para garantir a integridade, confiabilidade e precisão dos dados.

- Ferramentas de dados: Desenvolver e utilizar ferramentas para extrair, transformar e analisar dados.

Extração, Tratamento e Carregamento (ETL)

O ETL (Extract, Transform, Load) é um processo crucial na jornada da qualidade dos dados. Ele envolve:

- Extração: Coleta de dados de diversas fontes, como bancos de dados, sistemas legados e APIs.

- Transformação: Limpeza, padronização e formatação dos dados para torná-los compatíveis com a análise.

- Carregamento: Armazenamento dos dados tratados em um data warehouse ou banco de dados analítico para análise.

Assim, caminhamos para o estado da arte, o self-service BI. E para que o Self-Service BI funcione de forma eficaz, é fundamental que os dados brutos sejam preparados e tratados adequadamente. Esse processo envolve diversas etapas, como:

- Limpeza de dados: Identificação e correção de erros, inconsistências e duplicidades nos dados.

- Organização de dados: Estruturação dos dados em um formato que facilite o acesso e a análise.

- Enriquecimento de dados: Integração de dados de diferentes fontes para fornecer uma visão completa das informações.

- Padronização de dados: Criação de um conjunto de regras e convenções para garantir a consistência dos dados.

- Gerenciamento de segurança: Implementação de medidas de segurança para proteger os dados contra acessos não autorizados.

- Cultura data-driven: O Self-Service BI promove uma cultura data-driven na organização, onde todos os colaboradores se sentem capacitados a utilizar os dados para tomar decisões mais informadas.

Isso leva a uma maior colaboração e inovação, impulsionando o crescimento da organização. - Melhoria na comunicação: Ao fornecer uma plataforma comum para o acesso e análise de dados, o Self-Service BI facilita a comunicação e a colaboração entre diferentes departamentos. Isso garante que todos estejam na mesma página e trabalhando em conjunto para alcançar os objetivos da organização.

Tudo isso pode contribuir para que os tão desejados dashboards sejam, de fato, confiáveis em suas análises.

Self-Service BI: Democratização do Acesso à Informação para Todos

Finalmente, em um mundo cada vez mais data-driven, a capacidade de acessar, analisar e interpretar informações se torna crucial para o sucesso em diversos setores.

O Self-Service BI (Business Intelligence) surge como uma ferramenta poderosa para democratizar o acesso à informação, permitindo que qualquer pessoa, independentemente de sua expertise técnica, possa extrair insights valiosos dos dados.

O Self-Service BI é uma abordagem tecnológica que fornece interfaces intuitivas e fáceis de usar, permitindo que usuários não técnicos explorem e analisem dados sem a necessidade de depender de especialistas em BI.

Essa democratização do acesso à informação permite que todos os departamentos e níveis hierárquicos de uma organização tomem decisões mais inteligentes e baseadas em dados.

Benefícios do Self-Service BI:

- Agilidade na tomada de decisões: Com o Self-Service BI, os usuários podem acessar e analisar dados rapidamente, sem a necessidade de esperar por relatórios ou análises geradas por especialistas. Isso permite uma tomada de decisões mais ágil e eficaz, aproveitando as oportunidades e respondendo rapidamente aos desafios.

- Aumento da produtividade: Ao ter acesso aos dados relevantes, os usuários podem realizar suas tarefas de forma mais eficiente e produtiva. Isso leva a uma redução no tempo gasto em tarefas repetitivas e permite que os colaboradores se concentrem em atividades de maior valor estratégico.

O Self-Service BI é uma ferramenta poderosa que democratiza o acesso à informação e permite que todos os membros de uma organização tomem decisões mais inteligentes e baseadas em dados.

Através de um processo bem executado de tratamento de dados brutos, o Self-Service BI pode ser implementado com sucesso, proporcionando diversos benefícios para a organização, como aumento da agilidade, da produtividade, da comunicação e da cultura data-driven.

Lembre-se: O Self-Service BI não elimina a necessidade de especialistas em engenharia de dados.

Pelo contrário, os engenheiros de dados continuam a ser essenciais para definir a estratégia de BI da organização, desenvolver modelos de análise complexos e garantir a qualidade dos dados.

Ao invés de perder tempo procurando qual ferramenta é a melhor, concentre-se em tratar e organizar os dados.

Por fim, uma base de dados sólida e confiável é crucial para que estes dados sirvam de alicerce para análises de informações confiáveis.

Então, antes de falar de ferramenta, faça a pergunta: como estão organizados os nossos dados?

Boa análise para você ☺️

Referências

- Um panorama completo das principais tendências sobre dados

- Engenharia de Dados: Um Guia Completo para Iniciantes

- Mercado de Engenharia de Dados no Brasil: Salários, Vagas e Tendências

- Engenharia de Dados para Big Data: Desafios e Oportunidades

- Construindo um Data Lake com Apache Spark e Delta Lake

- The State of Data Engineering in 2023

- Data Engineering: The Ultimate Guide

- 10 Skills Every Data Engineer Should Have in 2023

- The Data Engineering Roadmap